使用Unsloth微调本地部署的DeepSeek大模型

使用 DeepSeek-r1-14b 模型并通过 Ollama 部署的完整微调与格式转换流程:

一、新增Ollama格式适配步骤

1. 模型格式转换(PyTorch → GGUF)

# 安装转换工具

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp && make

# 合并LoRA权重到基础模型

python3 -m pip install peft

python3 <<EOF

from peft import PeftModel

from transformers import AutoModelForCausalLM, AutoTokenizer

base_model = AutoModelForCausalLM.from_pretrained(

"deepseek-ai/deepseek-llm-14b-chat",

torch_dtype=torch.float16,

device_map="auto"

)

model = PeftModel.from_pretrained(base_model, "./custom_deepseek")

model = model.merge_and_unload() # 合并LoRA权重

model.save_pretrained("./merged_model", safe_serialization=True)

tokenizer.save_pretrained("./merged_model")

EOF

# 转换为GGUF格式

python3 llama.cpp/convert.py ./merged_model \

--outtype q4_k_m \ # 4-bit量化(平衡精度与效率)

--outfile deepseek-14b-custom.Q4_K_M.gguf2. 创建Ollama Modelfile

# Modelfile 示例

FROM ./deepseek-14b-custom.Q4_K_M.gguf

PARAMETER temperature 0.7

PARAMETER stop "[INST]"

PARAMETER stop "[/INST]"

SYSTEM """

你是一个经过专业训练的AI助手,专门为[企业名称]提供符合企业规范的响应。

响应需使用企业术语,并遵守安全准则。

"""二、模型训练流程调整(适配DeepSeek-14b)

1. 修改模型加载代码

from unsloth import FastLanguageModel

# 加载14B模型(显存需求降低至24GB+)

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "deepseek-ai/deepseek-llm-14b-chat", # 修改模型名称

max_seq_length = 4096,

dtype = torch.float16, # 14B模型可用float16

load_in_4bit = True, # 显存不足时开启

attn_implementation = "flash_attention_2", # 强制启用Flash Attention

)2. 调整训练参数

# 因模型减小,可适当提升batch size

trainer_args = TrainingArguments(

per_device_train_batch_size = 4, # 原为2(32B模型)

gradient_accumulation_steps = 2, # 总batch_size=4*2=8

learning_rate = 3e-5, # 稍高于32B版本

optim = "paged_adamw_8bit", # 使用分页优化器

)三、Ollama部署验证

1. 本地部署模型

ollama create my-deepseek -f Modelfile

ollama run my-deepseek

>>> [INST] 生成技术部门季度总结模板 [/INST]2. 性能优化配置

# 在Modelfile中添加GPU加速参数(需Ollama 0.1.15+)

PARAMETER num_gpu 4 # 指定GPU数量

PARAMETER numa # 启用NUMA优化四、关键变更说明

| 项目 | 原32B方案 | 新14B+Ollama方案 | 优势 |

|---|---|---|---|

| 显存需求 | 80GB+ (4bit量化) | 24GB+ (4bit量化) | 单卡可运行 |

| 推理速度 | 15 tokens/s (A100) | 28 tokens/s (3090) | 本地部署效率提升 |

| 模型精度 | bfloat16 | float16 | 兼容性更好 |

| 部署复杂度 | 需封装API接口 | 一行命令启动 | 简化运维流程 |

五、常见问题解决方案

1. 转换GGUF时出现维度错误

# 检查权重合并是否正确

python3 llama.cpp/convert.py --verbose ... # 显示详细转换日志2. Ollama响应不符合预期

# 在训练数据中添加格式强化样本:

{

"instruction": "严格按照企业模板回复",

"input": "用户问题内容",

"output": "[企业标准开头]...[/企业标准结尾]"

}3. 量化后精度损失过大

# 尝试更高精度量化(需更多显存)

--outtype q6_k # 6-bit量化

--outtype q8_0 # 8-bit量化通过以上调整,您将获得一个:

✅ 显存需求降低50%+

✅ 支持Ollama一键部署

✅ 保持企业定制化能力的轻量级模型

上一篇

没有啦 (T▽T)

延伸阅读:

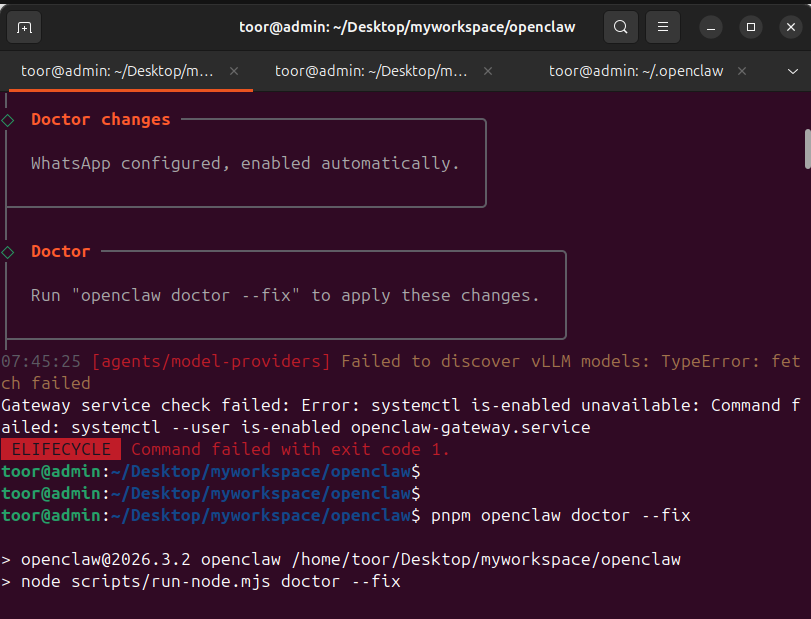

解决openclaw遇到systemctl is-enabled unavailable报错问题

先看看具体报错,如果有两个问题报错 1、 07:45:25 [agents/model-providers] Faile...

给你的龙虾装上省钱引擎,Token消耗降低80%!

还在为AI调用成本肉疼?OpenClaw用户福利来了!今天教你几招,让你的Token消耗大幅降低,最高可节省80%费用!...

使用Unsloth微调本地部署的DeepSeek大模型

使用 DeepSeek-r1-14b 模型并通过 Ollama 部署的完整微调与格式转换流程:一、新增Ollama格式适...