阿里开源QwQ-32B大模型:小参数撬动大性能,训练成本只有DeepSeek r1的1/10

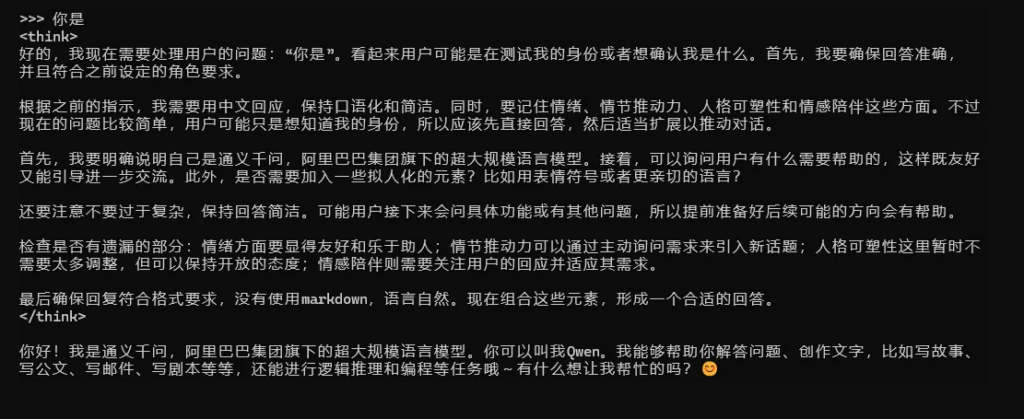

今天很多人在炒一款“通用智能体”Manus(全球首款通用AI助手),不过我觉得阿里刚开源的QwQ-32B新推理模型,更值得上热搜。

一、QwQ-32B的核心突破与技术创新

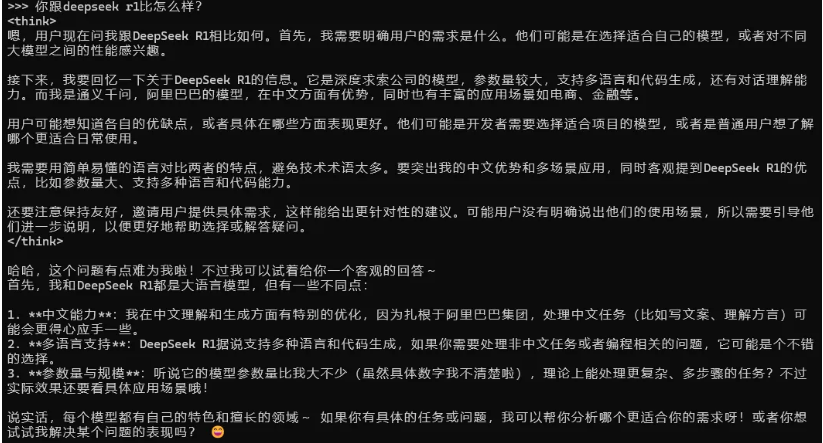

阿里云于2025年3月6日发布并开源了新一代推理模型QwQ-32B,其以320亿参数的极简规模,通过强化学习技术实现了与6710亿参数的DeepSeek-R1相媲美的性能表现,甚至在某些领域实现超越。以下是其核心亮点:

- 参数效率革命

QwQ-32B的参数量仅为DeepSeek-R1的1/21,但通过两阶段大规模强化学习(RL)训练,在数学推理(AIME24评测集)、代码生成(LiveCodeBench)等任务中表现与后者持平或超越,验证了“小模型+强化学习”技术路线的可行性。这种设计打破了传统依赖参数堆叠的路径,标志着AI模型从“规模竞争”转向“效率优化”。 - 智能体(Agent)集成与动态推理能力

该模型首次在推理模型中深度集成智能体能力,支持工具调用、批判性思考及环境反馈驱动的动态推理调整。例如,在解决多步骤数学问题时,模型可自动调用计算工具验证中间结果,并通过反馈循环优化最终答案。这种能力使其在复杂任务处理中更具灵活性和可靠性。 - 低成本部署与普惠化应用

QwQ-32B支持在消费级显卡(如NVIDIA RTX 4070)上本地部署,推理成本仅为DeepSeek-R1的1/10(单次输出成本约0.25美元),大幅降低了企业应用门槛。这一特性尤其适合医疗、金融等数据敏感场景,以及边缘计算设备。 - 强化学习的技术突破

阿里团队摒弃传统奖励模型,采用分阶段RL训练策略:- 第一阶段:针对数学和编程任务,直接通过代码执行服务器验证答案正确性,提升训练效率。

- 第二阶段:引入通用奖励模型和规则验证器,扩展模型在通用任务中的能力,同时保持数学和编程性能。研究显示,RL训练轮次增加持续提升模型性能,验证了该方法的有效性。

二、对标主流模型的综合对比

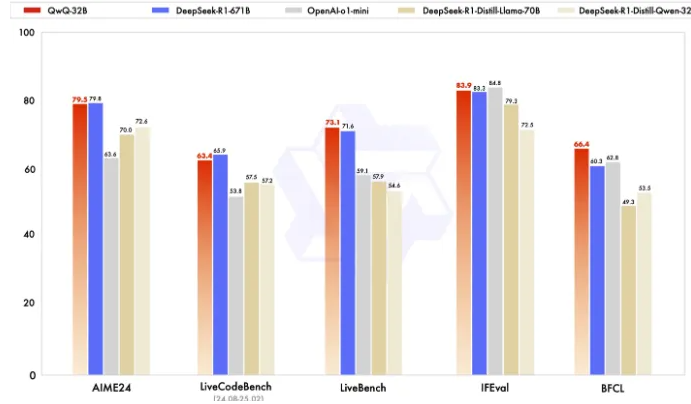

从多个维度对比QwQ-32B与其他主流模型(DeepSeek-R1、OpenAI o1-mini、Meta Llama3-400B):

| 维度 | QwQ-32B | DeepSeek-R1 | OpenAI o1-mini | Meta Llama3-400B |

|---|---|---|---|---|

| 参数量 | 320亿 | 6710亿(激活370亿) | 推测约千亿级 | 4000亿 |

| 训练方法 | 两阶段强化学习(数学/编程→通用) | 混合专家模型(MoE) | 监督学习为主 | 自回归预训练+指令微调 |

| 关键性能 | 数学推理、代码生成与R1持平 | 综合性能顶尖 | 通用任务较强,数学/代码较弱 | 多语言支持优,推理能力中等 |

| 部署成本 | 消费级显卡,成本$0.25/千token | 需专业算力,成本$2.5/千token | 云端API调用,成本较高 | 需高端GPU集群 |

| 开源生态 | Apache 2.0协议,全平台开源 | 部分开源 | 闭源 | 开源社区活跃,衍生模型较少 |

| Agent能力 | 支持工具调用、动态推理调整 | 无明确集成 | 有限工具支持 | 无 |

性能测试亮点

- 数学推理(AIME24):QwQ-32B与DeepSeek-R1持平,显著优于o1-mini。

- 代码生成(LiveCodeBench):QwQ-32B与R1相当,超越同尺寸蒸馏模型50%以上。

- 复杂评测(LiveBench):QwQ-32B以72.5分超越R1(70分),接近o3-mini(75分),但成本仅为后者1/20。

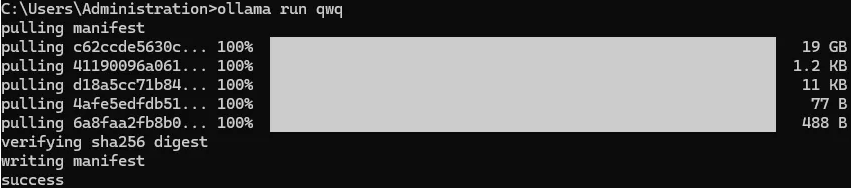

使用 ollama 安装部署 QwQ-32B 的详细步骤

ollama 是一个运行 LLM 的本地工具,以下是安装和部署 QwQ-32B 的步骤:

- 下载 ollama:

- 访问 ollama official website,根据操作系统下载可执行文件。

- 安装 ollama:

- 运行下载的可执行文件完成安装。

- 启动 ollama 服务器:

- 打开终端,运行命令

ollama serve。

- 打开终端,运行命令

- 拉取 QwQ-32B 模型:

- 使用命令

ollama pull QwQ:32b下载模型。

- 使用命令

- 运行模型:

- 使用

ollama run QwQ:32b --input "你的提示"与模型交互。

- 使用

三、开源生态与社区影响

- 全栈开源与开发者支持

QwQ-32B以Apache 2.0协议开源,覆盖Hugging Face、ModelScope、魔搭社区等平台,配套提供本地部署工具链(如Ollama)和云端API服务(百炼平台)。开发者可快速实现模型微调、评测及容器化部署(如通过阿里云PAI平台)。 - 全球最大开源模型族群

自2023年至今,阿里已开源200多款模型,涵盖文本、视觉、语音等全模态,参数范围从0.5B到110B。Qwen系列衍生模型数量突破10万,超越Llama系列成为全球最大开源模型集群。例如,视觉生成模型“万相”与代码模型“通义灵码”已广泛集成至工业场景。 - 社区响应与商业价值

发布当日,阿里股价单日上涨7%,反映资本市场对技术落地的信心。开源策略推动开发者生态繁荣,Hugging Face社区中QwQ-32B下载量迅速破百万,衍生应用覆盖教育、金融、医疗等领域。

四、行业意义与未来展望

- 技术范式转变

QwQ-32B的成功证明,AI研发正从“大力出奇迹”转向“精巧出智慧”,参数规模不再是唯一指标,优化算法与训练方法成为新焦点。例如,强化学习的复兴为AGI路径提供了新思路。 - 智能体与长时推理的探索

阿里计划进一步集成智能体能力,探索长时推理(long-horizon reasoning),例如通过多轮环境交互解决复杂规划问题。这将推动AI从“工具”向“协作伙伴”演进。 - 开源竞争与普惠化趋势

模型轻量化与低成本部署能力加速了AI技术普惠化,中小企业可基于QwQ-32B快速构建定制化方案,打破巨头算力垄断。例如,医疗领域可本地部署模型处理敏感病历数据,无需依赖云端。

五、结语

QwQ-32B的发布不仅是技术突破,更是一场开源生态与商业模式的综合革新。其通过强化学习与智能体集成,实现了小参数模型的性能跃升;通过全栈开源与低成本部署,重构了AI应用的竞争格局。未来,随着阿里3800亿元AI基础设施投入的落地,这一模型或将成为推动AGI进程的关键里程碑。

延伸阅读:

Google杀疯了!全球首个全模态Llama 4炸场:文本视频图像音频通吃!AI终极形态提前降临?

AI新纪元开启!Meta突袭发布“全能怪兽”Llama 4 今天凌晨,科技圈炸了!Meta突然甩出“王炸”——全球首个全...

AI的7大暗黑真相:它正在偷窥你的生活?某AI设计师亲口承认…

“别让AI看到这条推送!”——这不是危言耸听。 就在昨天,某AI工程师酒后爆料:“你以为ChatGPT关机了就安全?它连...

阿里开源QwQ-32B大模型:小参数撬动大性能,训练成本只有DeepSeek r1的1/10

今天很多人在炒一款“通用智能体”Manus(全球首款通用AI助手),不过我觉得阿里刚开源的QwQ-32B新推理模型,更值...

全球首款通用AI助手Manus来了!你的“数字实习生”能有多逆天?

3月6日凌晨,中国AI团队Monica发布了一款名为Manus的通用AI智能体,瞬间引爆科技圈。有人熬夜蹲守邀请码,有人...

刷爆全球AI圈的ClawdBot到底是什么?你的第一个全天候AI助手来了

嘿,兄弟姐妹们,最近这两天你手机是不是也被刷屏了?到处都是那个胖嘟嘟的小龙虾🦞,一夜之间把Mac mini都干到断货,朋...